产品详情

Vidnoz的Talking Head是一款在线工具,可让您在几分钟内创建逼真的说话头像。它利用人工智能技术生成具有口型和声音的头像视频,可用于销售、营销、沟通和支持等多种场景。Talking Head提供免费使用,同时也提供付费套餐以享受更多高级功能。

主要功能

适用人群

适用于需要展示逼真说话头像的场景,如网页、广告、教育等。

快速访问

访问官网 →所属分类

相关推荐

发现更多类似的优质AI工具

造点 AI

夸克・造点 AI 是一个利用先进的 AI 技术生成图像和视频的平台,用户可以通过简单的输入生成视觉内容。它的主要优点是快速高效,适用于设计师、艺术家和内容创作者。该产品为用户提供灵活的创作工具,帮助他们在短时间内实现创意构思,定价模式灵活,为用户提供了更多选择。

Photo to video ai

图片转视频AI生成器利用先进的AI模型,将静态图片转换为引人注目的视频,适用于社交媒体创作者和任何想要体验AI视频生成的人。产品定位于简化视频制作流程,提高效率。

AI Animate Image

AI Animate Image利用先进的AI技术,将静态图片转化为生动的动画,提供专业级动画质量和流畅的动态效果。

Grok Imagine

Grok Imagine是由Aurora引擎驱动的AI图像和视频生成平台,可生成多领域的逼真图像和动态视频内容。其核心技术基于Aurora引擎的自回归图像模型,为用户提供高质量、多样化的视觉创作体验。

MuAPI

WAN 2.1 LoRA T2V是一款能够根据文本提示生成视频的工具,通过LoRA模块的定制训练,用户可以定制化生成视频,适用于品牌叙事、粉丝内容和风格化动画。产品背景丰富,提供高度定制化的视频生成体验。

Openjourney

Openjourney 是一个高保真的开源项目,旨在模拟 MidJourney 的界面,利用 Google 的 Gemini SDK 进行 AI 图像和视频生成。该项目支持使用 Imagen 4 生成高质量图像,以及使用 Veo 2 和 Veo 3 进行文本到视频和图像到视频的转换。它适合需要进行图像生成和视频制作的开发者和创作者,提供了用户友好的界面和实时生成体验,能够助力创意工作与项目开发。

A2E Free and Uncensored AI Videos

a2e.ai是一款AI工具,提供AI头像、唇形同步、语音克隆、文字生成视频等功能。该产品具有高清晰度、高一致性、高效生成速度等优点,适用于各种场景,提供完整的头像AI工具集。

FlyAgt.ai

FlyAgt是一个AI图像和视频生成平台,提供先进的AI工具,从创建到编辑再到增强图像。它的主要优点在于价格实惠,提供多种专业工具,并保护用户隐私。

DreamVid

iMyFone DreamVid是一款强大的AI图像转视频工具,通过上传照片,AI可以将静态图像转化为生动的视频,包括拥抱、亲吻、面部交换等特效。该工具背景信息丰富,价格适中,定位于个人用户和小型企业。

Everlyn.AI

Everlyn AI是世界领先的AI视频生成器和免费AI图片生成器,使用先进的AI技术将您的想法转化为令人惊叹的视觉效果。它具有颠覆性的性能指标,包括15秒快速生成速度、25倍降低成本、8倍更高效率。

Describe Anything

Describe Anything 模型(DAM)能够处理图像或视频的特定区域,并生成详细描述。它的主要优点在于可以通过简单的标记(点、框、涂鸦或掩码)来生成高质量的本地化描述,极大地提升了计算机视觉领域的图像理解能力。该模型由 NVIDIA 和多所大学联合开发,适合用于研究、开发和实际应用中。

vivago.ai

vivago.ai 是一个免费的 AI 生成工具和社区,提供文本转图像、图像转视频等功能,让创作变得更加简单高效。用户可以免费生成高质量的图像和视频,支持多种 AI 编辑工具,方便用户进行创作和分享。该平台的定位是为广大创作者提供易用的 AI 工具,满足他们在视觉创作上的需求。

Stable Virtual Camera

Stable Virtual Camera是Stability AI开发的一个1.3B参数的通用扩散模型,属于Transformer图像转视频模型。其重要性在于为新型视图合成(NVS)提供了技术支持,能够根据输入视图和目标相机生成3D一致的新场景视图。主要优点是可自由指定目标相机轨迹,能生成大视角变化且时间上平滑的样本,无需额外神经辐射场(NeRF)蒸馏即可保持高一致性,还能生成长达半分钟的高质量无缝循环视频。该模型仅可免费用于研究和非商业用途,定位是为研究人员和非商业创作者提供创新的图像转视频解决方案。

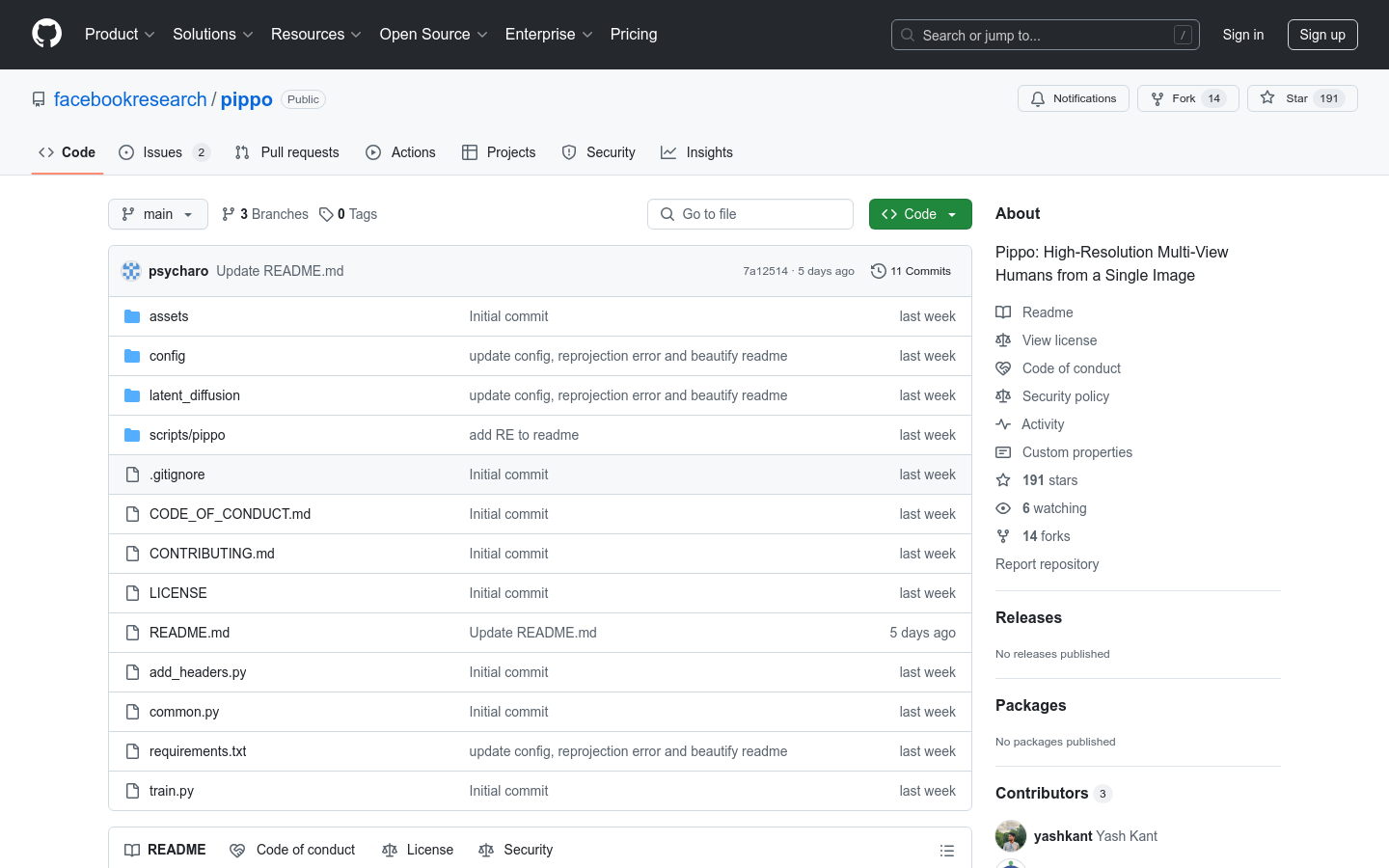

Pippo

Pippo 是由 Meta Reality Labs 和多所高校合作开发的生成模型,能够从单张普通照片生成高分辨率的多人视角视频。该技术的核心优势在于无需额外输入(如参数化模型或相机参数),即可生成高质量的 1K 分辨率视频。它基于多视角扩散变换器架构,具有广泛的应用前景,如虚拟现实、影视制作等。Pippo 的代码已开源,但不包含预训练权重,用户需要自行训练模型。

Animate Anyone 2

Animate Anyone 2 是一种基于扩散模型的角色图像动画技术,能够生成与环境高度适配的动画。它通过提取环境表示作为条件输入,解决了传统方法中角色与环境缺乏合理关联的问题。该技术的主要优点包括高保真度、环境适配性强以及动态动作处理能力出色。它适用于需要高质量动画生成的场景,如影视制作、游戏开发等领域,能够帮助创作者快速生成具有环境交互的角色动画,节省时间和成本。

X-Dyna

X-Dyna是一种创新的零样本人类图像动画生成技术,通过将驱动视频中的面部表情和身体动作迁移到单张人类图像上,生成逼真且富有表现力的动态效果。该技术基于扩散模型,通过Dynamics-Adapter模块,将参考外观上下文有效整合到扩散模型的空间注意力中,同时保留运动模块合成流畅复杂动态细节的能力。它不仅能够实现身体姿态控制,还能通过本地控制模块捕捉与身份无关的面部表情,实现精确的表情传递。X-Dyna在多种人类和场景视频的混合数据上进行训练,能够学习物理人体运动和自然场景动态,生成高度逼真和富有表现力的动画。