产品详情

FiddleCube是一个专注于数据科学领域的产品,它能够快速地从用户的数据中生成问答对,帮助用户评估大型语言模型(LLMs)。它提供了准确的黄金数据集,支持多种问题类型,并能够通过度量标准来评估数据的准确性。此外,FiddleCube还提供了诊断工具,帮助用户找出并改进性能不佳的查询。

主要功能

使用教程

适用人群

目标受众主要是数据科学家、机器学习工程师和需要评估语言模型性能的研究人员。FiddleCube通过提供快速生成问答对和评估模型的工具,帮助他们解决创建高质量数据集的难题,从而提高模型评估的效率和准确性。

使用示例

Oren Dar,Intuit的数据科学家,认为FiddleCube解决了创建高质量数据集的核心挑战。

She-Lan,Interval Works的CEO,通过Y Combinator公司页面发现FiddleCube,认为它解决了所有问题,非常出色。

Shiv,Athina.ai的CEO,表示之前用户缺乏好的数据集来评估他们的模型,而FiddleCube让高质量评估数据集触手可及。

快速访问

访问官网 →所属分类

相关推荐

发现更多类似的优质AI工具

Firecrawl MCP Server

Firecrawl MCP Server 是一款集成了强大网页抓取功能的插件,支持多种 LLM 客户端如 Cursor 和 Claude。它能高效地抓取、搜索和提取网页内容,并提供自动重试及流量限制等功能,适合开发者和研究人员使用。该产品具有高度的灵活性与可扩展性,可用于批量抓取和深度研究。

DeepSeek-Prover-V2-671B

DeepSeek-Prover-V2-671B 是一个先进的人工智能模型,旨在提供强大的推理能力。它基于最新的技术,适用于多种应用场景。该模型是开源的,旨在促进人工智能技术的民主化与普及,降低技术壁垒,使更多开发者和研究者能够利用 AI 技术进行创新。通过使用该模型,用户可以提升他们的工作效率,推动各类项目的进展。

AoT

Atom of Thoughts (AoT) 是一种新型推理框架,通过将解决方案表示为原子问题的组合,将推理过程转化为马尔可夫过程。该框架通过分解和收缩机制,显著提升了大语言模型在推理任务上的性能,同时减少了计算资源的浪费。AoT 不仅可以作为独立的推理方法,还可以作为现有测试时扩展方法的插件,灵活结合不同方法的优势。该框架开源且基于 Python 实现,适合研究人员和开发者在自然语言处理和大语言模型领域进行实验和应用。

ViDoRAG

ViDoRAG 是阿里巴巴自然语言处理团队开发的一种新型多模态检索增强生成框架,专为处理视觉丰富文档的复杂推理任务设计。该框架通过动态迭代推理代理和高斯混合模型(GMM)驱动的多模态检索策略,显著提高了生成模型的鲁棒性和准确性。ViDoRAG 的主要优点包括高效处理视觉和文本信息、支持多跳推理以及可扩展性强。该框架适用于需要从大规模文档中检索和生成信息的场景,例如智能问答、文档分析和内容创作。其开源特性和灵活的模块化设计使其成为研究人员和开发者在多模态生成领域的重要工具。

Level-Navi Agent-Search

Level-Navi Agent是一个开源的通用网络搜索代理框架,能够将复杂问题分解并逐步搜索互联网上的信息,直至回答用户问题。它通过提供Web24数据集,覆盖金融、游戏、体育、电影和事件等五大领域,为评估模型在搜索任务上的表现提供了基准。该框架支持零样本和少样本学习,为大语言模型在中文网络搜索代理领域的应用提供了重要参考。

M2RAG

M2RAG是一个用于多模态上下文中的检索增强生成的基准测试代码库。它通过多模态检索文档来回答问题,评估多模态大语言模型(MLLMs)在利用多模态上下文知识方面的能力。该模型在图像描述、多模态问答、事实验证和图像重排等任务上进行了评估,旨在提升模型在多模态上下文学习中的有效性。M2RAG为研究人员提供了一个标准化的测试平台,有助于推动多模态语言模型的发展。

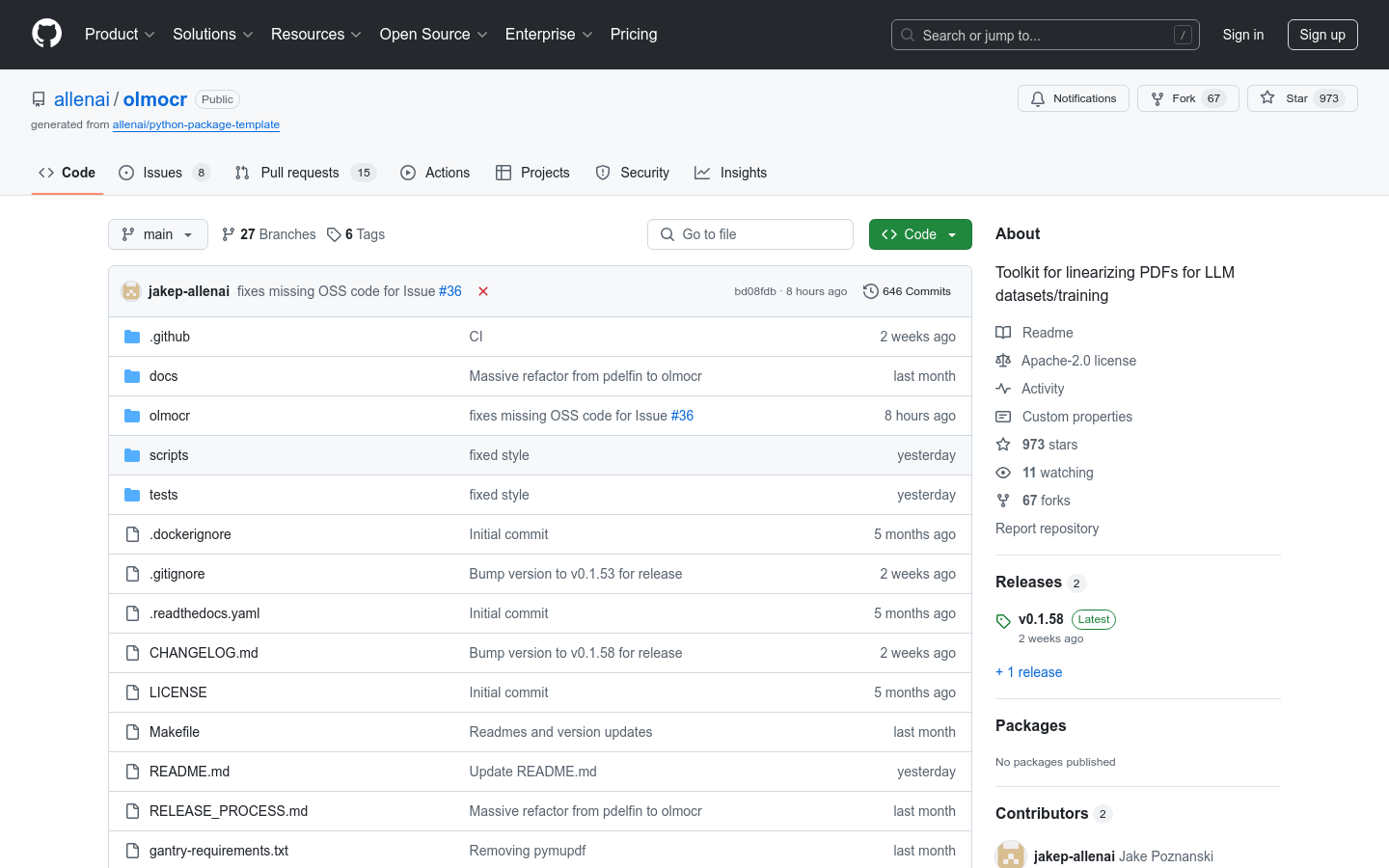

olmOCR

olmOCR是由Allen Institute for Artificial Intelligence (AI2)开发的一个开源工具包,旨在将PDF文档线性化,以便用于大型语言模型(LLM)的训练。该工具包通过将PDF文档转换为适合LLM处理的格式,解决了传统PDF文档结构复杂、难以直接用于模型训练的问题。它支持多种功能,包括自然文本解析、多版本比较、语言过滤和SEO垃圾信息移除等。olmOCR的主要优点是能够高效处理大量PDF文档,并通过优化的提示策略和模型微调,提高文本解析的准确性和效率。该工具包适用于需要处理大量PDF数据的研究人员和开发者,尤其是在自然语言处理和机器学习领域。

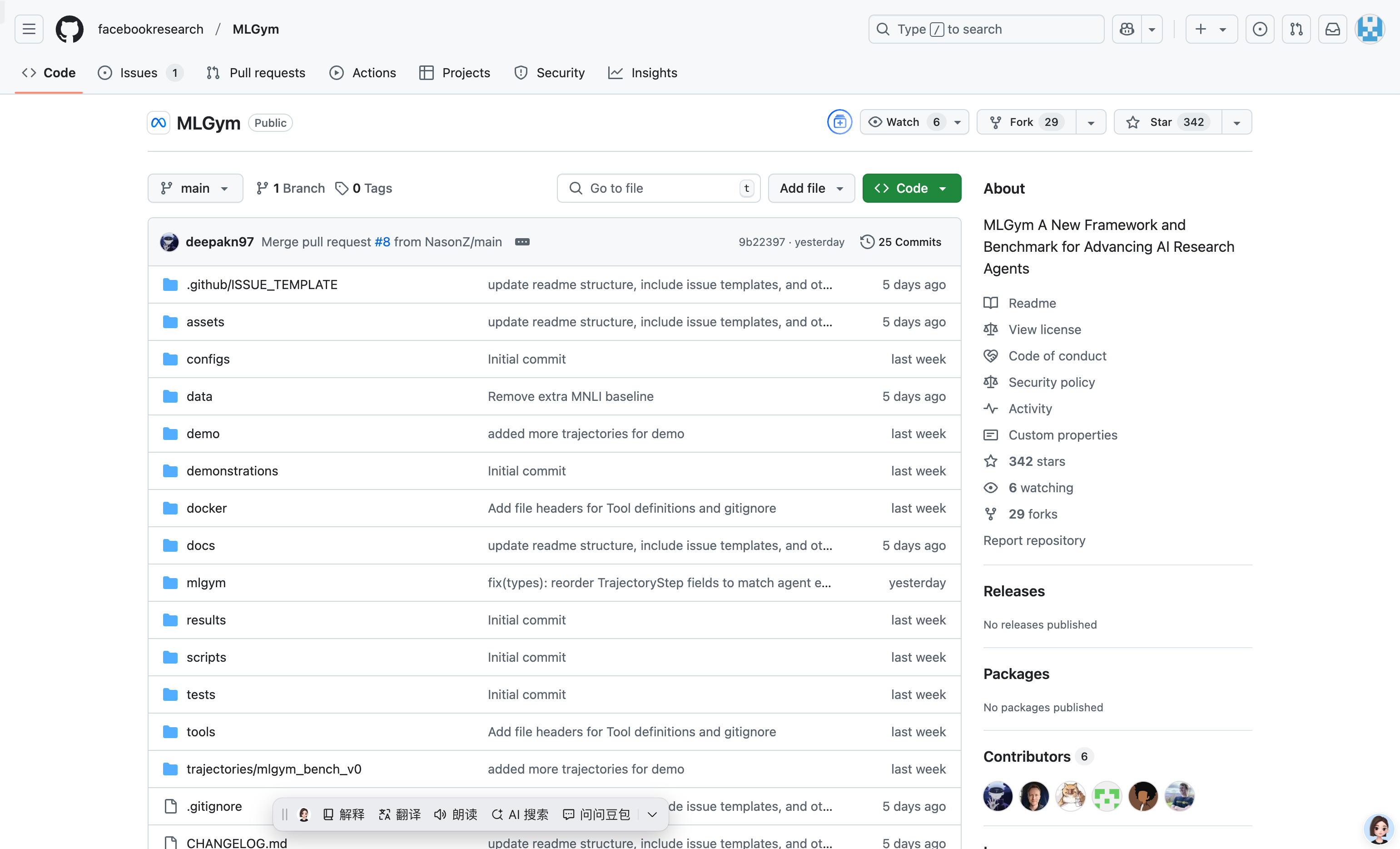

MLGym

MLGym是由Meta的GenAI团队和UCSB NLP团队开发的一个开源框架和基准,用于训练和评估AI研究代理。它通过提供多样化的AI研究任务,推动强化学习算法的发展,帮助研究人员在真实世界的研究场景中训练和评估模型。该框架支持多种任务,包括计算机视觉、自然语言处理和强化学习等领域,旨在为AI研究提供一个标准化的测试平台。

PIKE-RAG

PIKE-RAG 是微软开发的一种领域知识和推理增强生成模型,旨在通过知识提取、存储和推理逻辑增强大型语言模型(LLM)的能力。该模型通过多模块设计,能够处理复杂的多跳问答任务,并在工业制造、矿业和制药等领域显著提升了问答准确性。PIKE-RAG 的主要优点包括高效的知识提取能力、强大的多源信息整合能力和多步推理能力,使其在需要深度领域知识和复杂逻辑推理的场景中表现出色。

SWE-Lancer

SWE-Lancer 是由 OpenAI 推出的一个基准测试,旨在评估前沿语言模型在真实世界中的自由软件工程任务中的表现。该基准测试涵盖了从 50 美元的漏洞修复到 32000 美元的功能实现等多种独立工程任务,以及模型在技术实现方案之间的选择等管理任务。通过模型将性能映射到货币价值,SWE-Lancer 为研究 AI 模型开发的经济影响提供了新的视角,并推动了相关研究的发展。

Goedel-Prover

Goedel-Prover 是一款专注于自动化定理证明的开源大型语言模型。它通过将自然语言数学问题翻译为形式化语言(如 Lean 4),并生成形式化证明,显著提升了数学问题的自动化证明效率。该模型在 miniF2F 基准测试中达到了 57.6% 的成功率,超越了其他开源模型。其主要优点包括高性能、开源可扩展性以及对数学问题的深度理解能力。Goedel-Prover 旨在推动自动化定理证明技术的发展,并为数学研究和教育提供强大的工具支持。

OpenThinker-32B

OpenThinker-32B 是由 Open Thoughts 团队开发的一款开源推理模型。它通过扩展数据规模、验证推理路径和扩展模型大小来实现强大的推理能力。该模型在数学、代码和科学等推理基准测试中表现卓越,超越了现有的开放数据推理模型。其主要优点包括开源数据、高性能和可扩展性。该模型基于 Qwen2.5-32B-Instruct 进行微调,并在大规模数据集上训练,旨在为研究人员和开发者提供强大的推理工具。

RAG-FiT

RAG-FiT是一个强大的工具,旨在通过检索增强生成(RAG)技术提升大型语言模型(LLMs)的能力。它通过创建专门的RAG增强数据集,帮助模型更好地利用外部信息。该库支持从数据准备到模型训练、推理和评估的全流程操作。其主要优点包括模块化设计、可定制化工作流以及对多种RAG配置的支持。RAG-FiT基于开源许可,适合研究人员和开发者进行快速原型开发和实验。

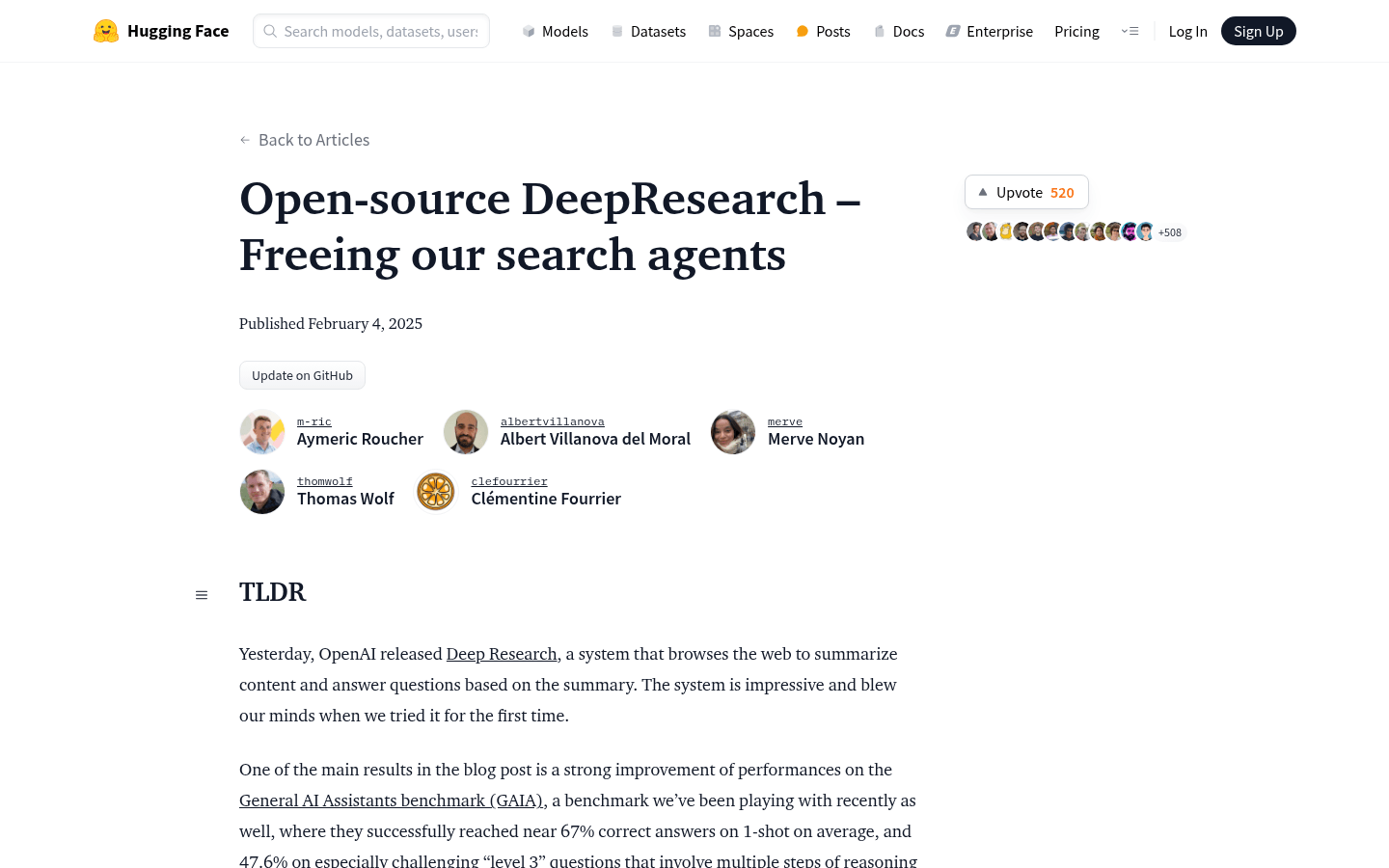

Open-source DeepResearch

Open-source DeepResearch 是一个开源项目,旨在通过开源的框架和工具复现类似 OpenAI Deep Research 的功能。该项目基于 Hugging Face 平台,利用开源的大型语言模型(LLM)和代理框架,通过代码代理和工具调用实现复杂的多步推理和信息检索。其主要优点是开源、可定制性强,并且能够利用社区的力量不断改进。该项目的目标是让每个人都能在本地运行类似 DeepResearch 的智能代理,使用自己喜爱的模型,并且完全本地化和定制化。

node-DeepResearch

node-DeepResearch 是一个基于 Jina AI 技术的深度研究模型,专注于通过持续搜索和阅读网页来寻找问题的答案。它利用 Gemini 提供的 LLM 能力和 Jina Reader 的网页搜索功能,能够处理复杂的查询任务,并通过多步骤的推理和信息整合来生成答案。该模型的主要优点在于其强大的信息检索能力和推理能力,能够处理复杂的、需要多步骤解答的问题。它适用于需要深入研究和信息挖掘的场景,如学术研究、市场分析等。目前该模型是开源的,用户可以通过 GitHub 获取代码并自行部署使用。

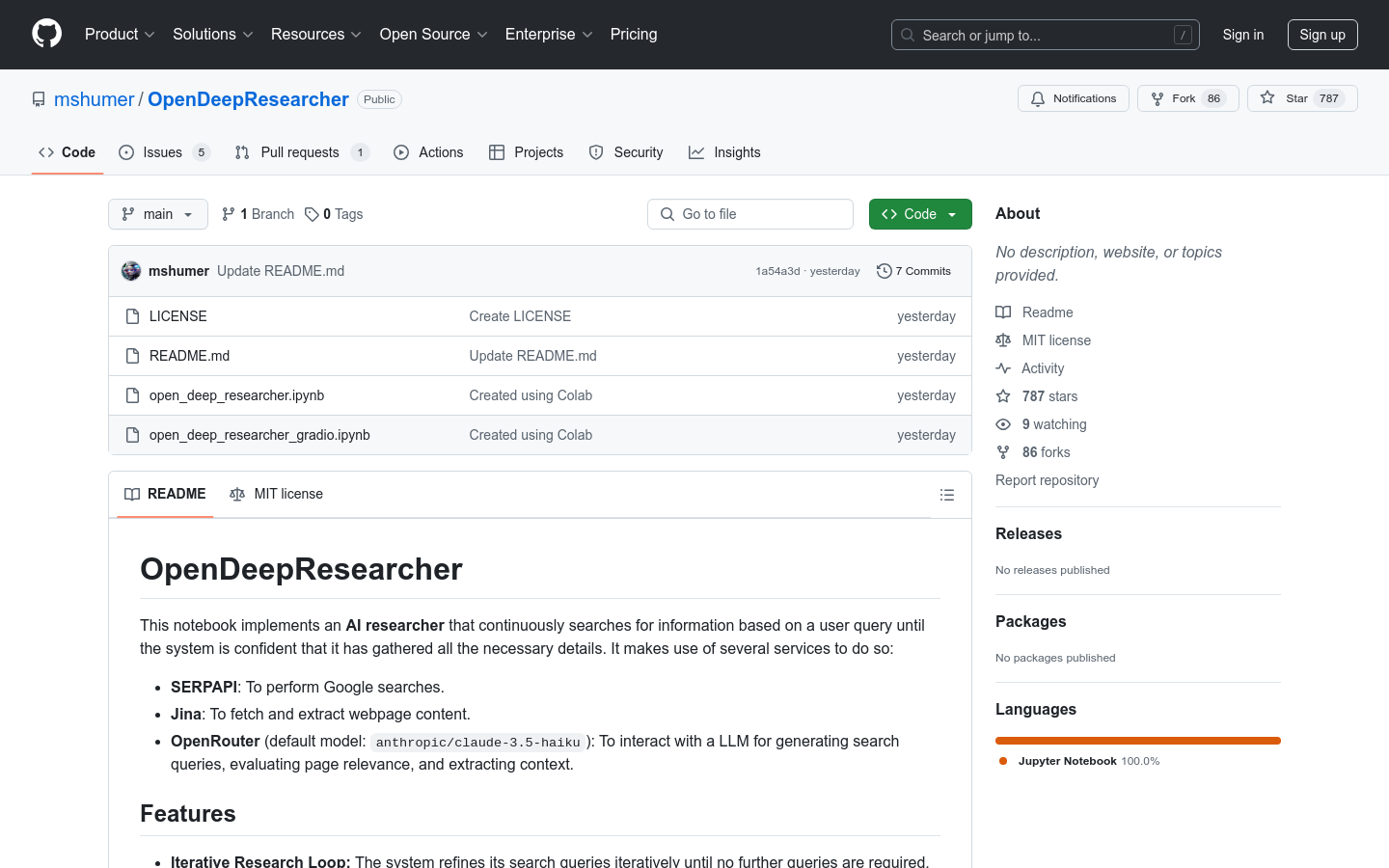

OpenDeepResearcher

OpenDeepResearcher 是一个基于 AI 的研究工具,通过结合 SERPAPI、Jina 和 OpenRouter 等服务,能够根据用户输入的查询主题,自动进行多轮迭代搜索,直至收集到足够的信息并生成最终报告。该工具的核心优势在于其高效的异步处理能力、去重功能以及强大的 LLM 决策支持,能够显著提升研究效率。它主要面向需要进行大量文献搜索和信息整理的科研人员、学生以及相关领域的专业人士,帮助他们快速获取高质量的研究资料。该工具目前以开源形式提供,用户可以根据需要自行部署和使用。