产品详情

ChatTTS是一个开源的文本到语音转换(TTS)模型,它允许用户将文本转换为语音。该模型主要面向学术研究和教育目的,不适用于商业或法律用途。它使用深度学习技术,能够生成自然流畅的语音输出,适合研究和开发语音合成技术的人员使用。

主要功能

使用教程

适用人群

ChatTTS模型适合语音技术研究者、开发者以及教育机构使用。研究者可以通过该模型探索和改进语音合成技术,开发者可以利用它快速开发语音交互应用,教育机构可以用它来教授语音合成相关的课程。

使用示例

研究人员使用ChatTTS模型进行语音合成技术的研究。

开发者利用ChatTTS开发智能助手或语音交互应用。

教育机构在课堂上使用ChatTTS教授语音合成的原理和应用。

快速访问

访问官网 →所属分类

相关推荐

发现更多类似的优质AI工具

Reverb

Reverb 是一个开源的语音识别和说话人分割模型推理代码,使用 WeNet 框架进行语音识别 (ASR) 和 Pyannote 框架进行说话人分割。它提供了详细的模型描述,并允许用户从 Hugging Face 下载模型。Reverb 旨在为开发者和研究人员提供高质量的语音识别和说话人分割工具,以支持各种语音处理任务。

Realtime API

Realtime API 是 OpenAI 推出的一款低延迟语音交互API,它允许开发者在应用程序中构建快速的语音到语音体验。该API支持自然语音到语音对话,并可处理中断,类似于ChatGPT的高级语音模式。它通过WebSocket连接,支持功能调用,使得语音助手能够响应用户请求,触发动作或引入新上下文。该API的推出,意味着开发者不再需要组合多个模型来构建语音体验,而是可以通过单一API调用实现自然对话体验。

Deepgram Voice Agent API

Deepgram Voice Agent API 是一个统一的语音到语音API,它允许人类和机器之间进行自然听起来的对话。该API由行业领先的语音识别和语音合成模型提供支持,能够自然且实时地听、思考和说话。Deepgram致力于通过其语音代理API推动语音优先AI的未来,通过集成先进的生成AI技术,打造能够进行流畅、类似人类语音代理的业务世界。

seed-vc

seed-vc 是一个基于 SEED-TTS 架构的声音转换模型,能够实现零样本的声音转换,即无需特定人的声音样本即可转换声音。该技术在音频质量和音色相似性方面表现出色,具有很高的研究和应用价值。

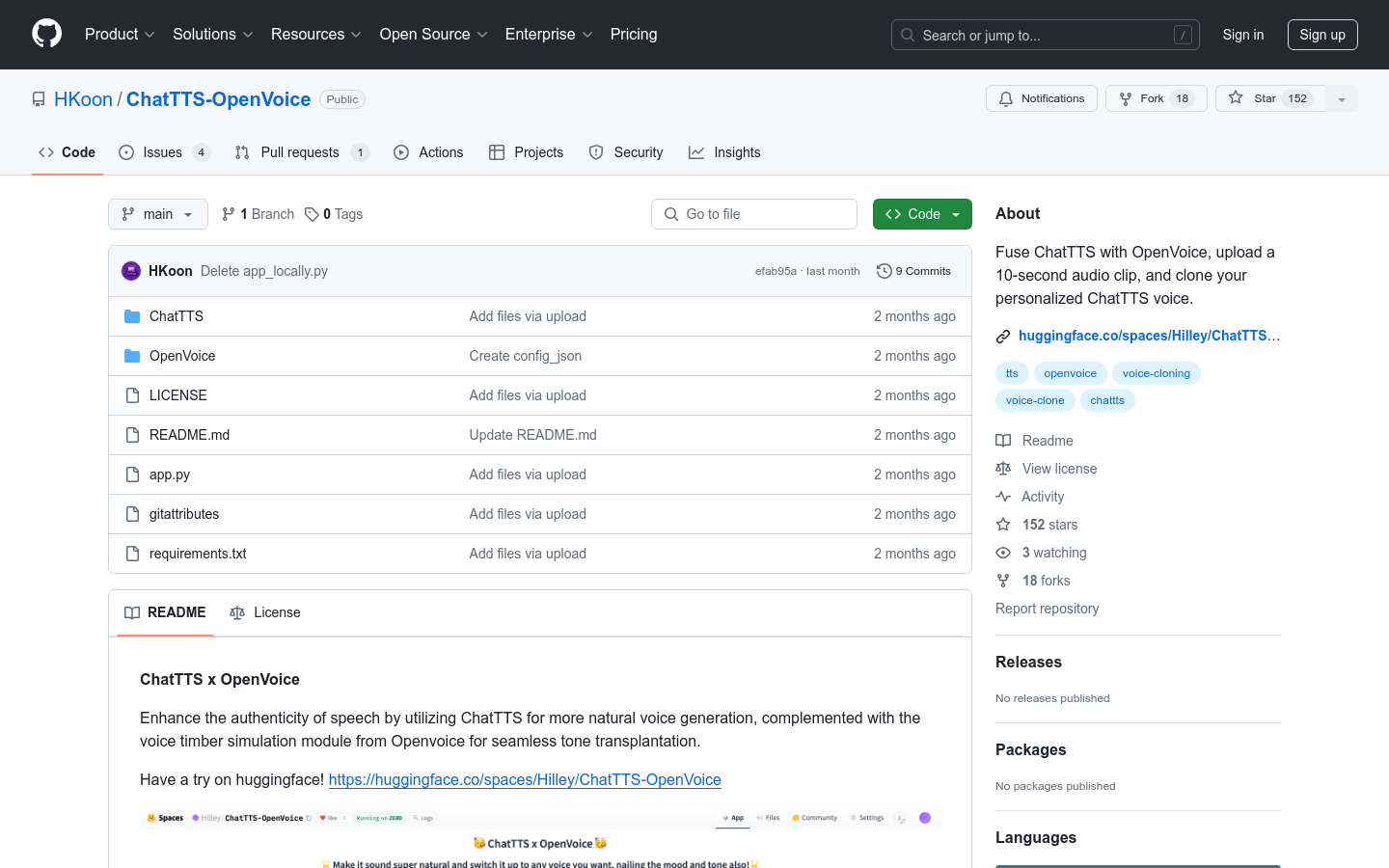

ChatTTS-OpenVoice

ChatTTS-OpenVoice是一个结合了ChatTTS和OpenVoice技术的语音克隆模型。它通过上传10秒音频片段,可以克隆个性化的语音,并生成更自然的语音。该技术在语音合成领域具有重要性,因为它提供了一种新的方式来生成逼真的语音,可以用于多种应用场景,如虚拟助手、有声读物等。

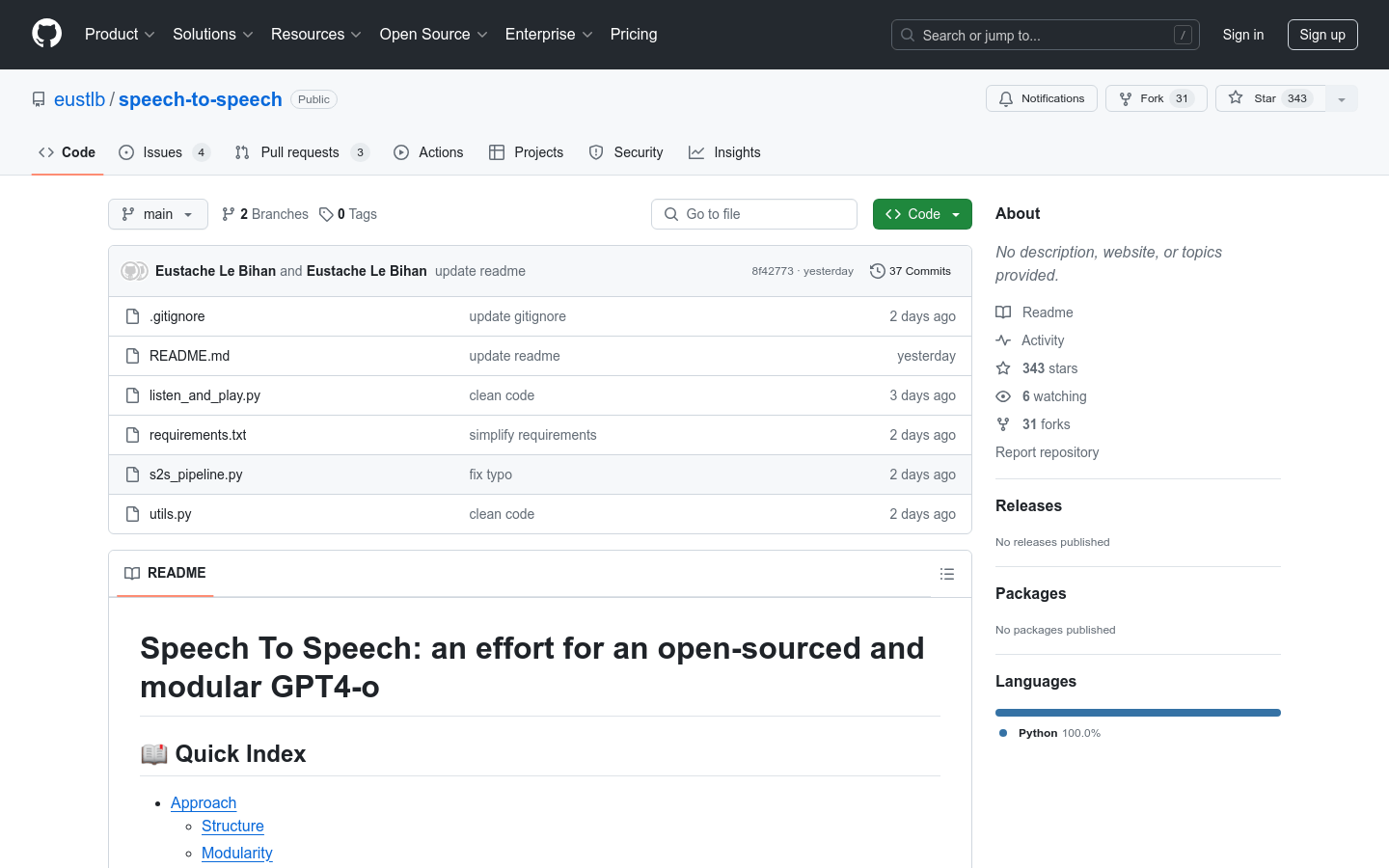

speech-to-speech

speech-to-speech 是一个开源的模块化GPT4-o项目,通过语音活动检测、语音转文本、语言模型和文本转语音等连续部分实现语音到语音的转换。它利用了Transformers库和Hugging Face hub上可用的模型,提供了高度的模块化和灵活性。

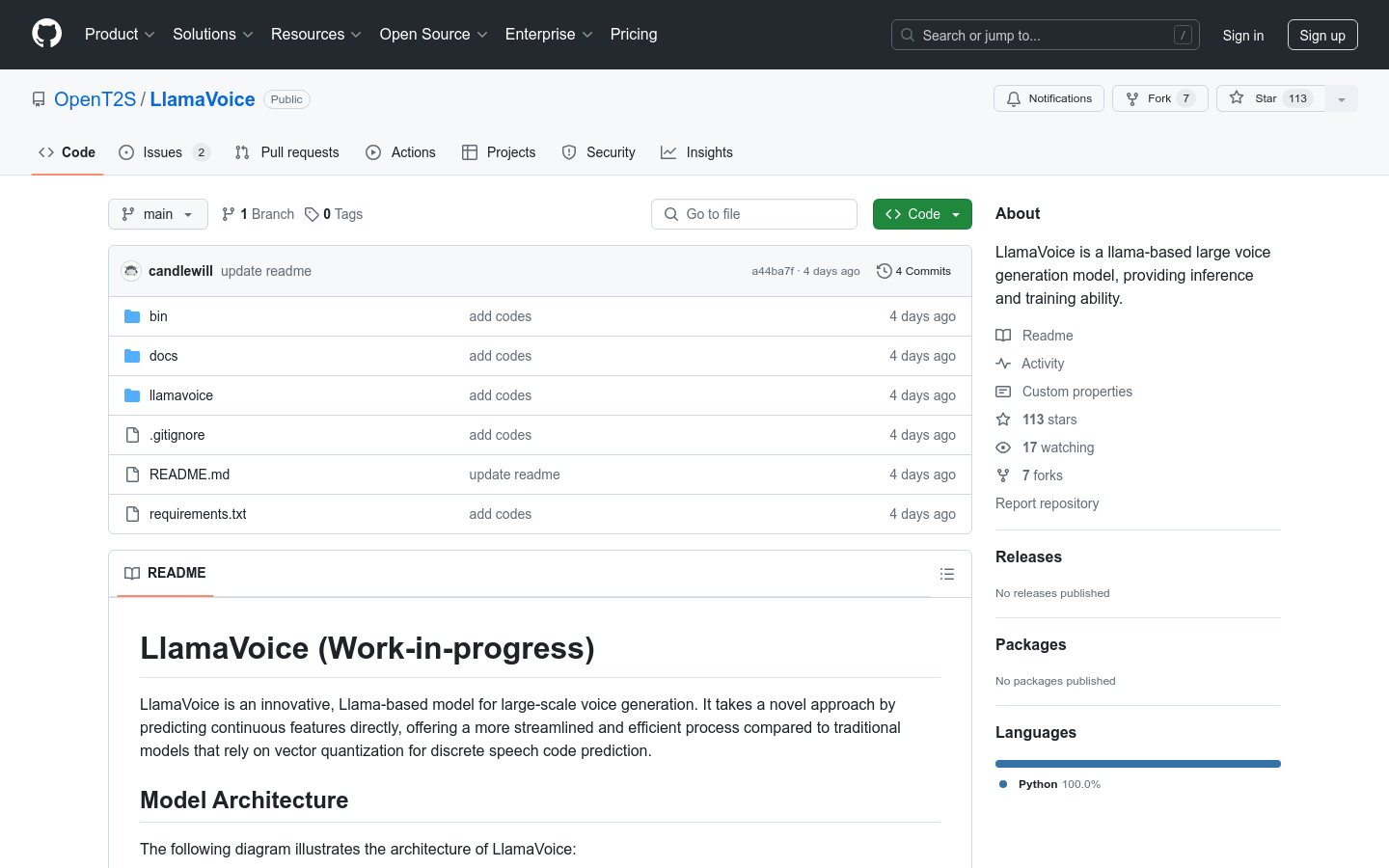

LlamaVoice

LlamaVoice是一个基于羊驼模型的大型语音生成模型,它通过直接预测连续特征,提供了一种与传统依赖于离散语音码预测的向量量化模型相比更为流畅和高效的处理过程。该模型具有连续特征预测、变分自编码器(VAE)潜在特征预测、联合训练、先进采样策略和基于流的增强等关键特点。

ElevenLabs AI audio API

ElevenLabs AI音频API提供了高质量的语音合成服务,支持多种语言,适用于聊天机器人、代理、网站、应用程序等,具有低延迟和高响应速度。该API支持企业级需求,确保数据安全,符合SOC2和GDPR合规性。

ChatTTS_Speaker

ChatTTS_Speaker是一个基于ERes2NetV2说话人识别模型的实验性项目,旨在对音色进行稳定性评分和音色打标,帮助用户选择稳定且符合需求的音色。项目已开源,支持在线试听和下载音色样本。

sherpa-onnx

sherpa-onnx 是一个基于下一代 Kaldi 的语音识别和语音合成项目,使用onnxruntime进行推理,支持多种语音相关功能,包括语音转文字(ASR)、文字转语音(TTS)、说话人识别、说话人验证、语言识别、关键词检测等。它支持多种平台和操作系统,包括嵌入式系统、Android、iOS、Raspberry Pi、RISC-V、服务器等。

seed-tts-eval

seed-tts-eval 是一个用于评估模型零样本语音生成能力的测试集,它提供了一个跨领域目标的客观评估测试集,包含从英语和普通话公共语料库中提取的样本,用于衡量模型在各种客观指标上的表现。它使用了Common Voice数据集的1000个样本和DiDiSpeech-2数据集的2000个样本。

ChatTTS-ui

ChatTTS-ui是一个为ChatTTS项目提供的web界面和API接口,允许用户通过网页进行语音合成操作,并通过API接口进行远程调用。它支持多种音色选择,用户可以自定义语音合成的参数,如笑声、停顿等。此项目为语音合成技术提供了一个易于使用的界面,降低了技术门槛,使得语音合成更加便捷。

SpeechGPT

SpeechGPT是一种多模态语言模型,具有内在的跨模态对话能力。它能够感知并生成多模态内容,遵循多模态人类指令。SpeechGPT-Gen是一种扩展了信息链的语音生成模型。SpeechAgents是一种具有多模态多代理系统的人类沟通模拟。SpeechTokenizer是一种统一的语音标记器,适用于语音语言模型。这些模型和数据集的发布日期和相关信息均可在官方网站上找到。