Microsoft Knowledge Exploration

使用知识探索API通过自然语言输入实现对结构化数据的交互式搜索体验。

产品详情

Project Knowledge Exploration是由Microsoft Research开发的一个用于结构化数据的交互式搜索API。它通过自然语言输入,解释用户的查询并返回相关的结果。该API支持自动完成查询、快速检索匹配对象的详细信息、使用属性直方图进行可视化和交互式的细分体验等功能。该产品可以广泛应用于各种场景,包括知识图谱、数据分析、智能搜索等。

主要功能

适用人群

该产品适用于需要在结构化数据上进行交互式搜索的场景,包括知识图谱、数据分析、智能搜索等。

使用示例

使用Knowledge Exploration API构建一个智能搜索引擎,让用户能够通过自然语言输入获取准确的搜索结果。

在一个数据分析项目中,使用Knowledge Exploration API实现对结构化数据的交互式探索和查询。

在一个知识图谱应用中,使用Knowledge Exploration API帮助用户从海量的结构化数据中获取准确的信息。

快速访问

访问官网 →所属分类

相关推荐

发现更多类似的优质AI工具

Chain-of-Table

Chain-of-Table是一种表格理解的推理链表框架,专门用于处理基于表格的问答和事实验证等任务。它采用了表格数据作为推理链的一部分,通过在上下文中学习的方式指导大型语言模型进行操作生成和表格更新,从而形成一个连续的推理链,展示了给定表格问题的推理过程。这种推理链包含了中间结果的结构化信息,能够实现更准确可靠的预测。Chain-of-Table在WikiTQ、FeTaQA和TabFact等多个基准测试中取得了新的最先进性能。

DocGraphLM

DocGraphLM是一种用于信息提取和问题解答的文档图语言模型。它采用了先进的视觉丰富文档理解技术,结合了预训练语言模型和图形语义。其独特之处在于提出了联合编码器架构来表示文档,并采用了一种新颖的链接预测方法来重构文档图。DocGraphLM通过收敛的联合损失函数预测节点之间的方向和距离,优先考虑邻域恢复并降低远程节点检测的权重。在三个SotA数据集上的实验表明,采用图形特征能够在信息提取和问题解答任务上实现一致的改进。此外,我们还报告说,采用图形特征能够加速训练过程中的收敛,尽管这些特征仅通过链接预测构建。

Radal

Radal是一个无代码平台,可使用您自己的数据微调小型语言模型,适用于需要定制人工智能而不涉及MLOps复杂性的初创公司、研究人员和企业。其主要优点是使用户能够快速训练和部署自定义语言模型,降低了技术门槛,节省时间成本。

Gitee AI

Gitee AI 汇聚最新最热 AI 模型,提供模型体验、推理、训练、部署和应用的一站式服务,提供充沛算力,定位为中国最好的 AI 社区。

MouSi

MouSi是一种多模态视觉语言模型,旨在解决当前大型视觉语言模型(VLMs)面临的挑战。它采用集成专家技术,将个体视觉编码器的能力进行协同,包括图像文本匹配、OCR、图像分割等。该模型引入融合网络来统一处理来自不同视觉专家的输出,并在图像编码器和预训练LLMs之间弥合差距。此外,MouSi还探索了不同的位置编码方案,以有效解决位置编码浪费和长度限制的问题。实验结果表明,具有多个专家的VLMs表现出比孤立的视觉编码器更出色的性能,并随着整合更多专家而获得显著的性能提升。

OpenAI Embedding Models

OpenAI Embedding Models是一系列新型嵌入模型,包括两个全新的嵌入模型和更新的GPT-4 Turbo预览模型、GPT-3.5 Turbo模型以及文本内容审核模型。默认情况下,发送到OpenAI API的数据不会用于训练或改进OpenAI模型。新的嵌入模型具有更低的定价,包括更小、高效的text-embedding-3-small模型和更大、更强大的text-embedding-3-large模型。嵌入是表示自然语言或代码等内容中概念的一系列数字。嵌入使得机器学习模型和其他算法更容易理解内容之间的关系,并执行聚类或检索等任务。它们为ChatGPT和Assistants API中的知识检索以及许多检索增强生成(RAG)开发工具提供支持。text-embedding-3-small是新的高效嵌入模型,相比其前身text-embedding-ada-002模型,性能更强,MIRACL的平均分数从31.4%提升至44.0%,而在英语任务(MTEB)的平均分数从61.0%提升至62.3%。text-embedding-3-small的定价也比之前的text-embedding-ada-002模型降低了5倍,从每千个标记的价格$0.0001降至$0.00002。text-embedding-3-large是新一代更大的嵌入模型,能够创建高达3072维的嵌入。性能更强,MIRACL的平均分数从31.4%提升至54.9%,而在MTEB的平均分数从61.0%提升至64.6%。text-embedding-3-large的定价为$0.00013/千个标记。此外,我们还支持缩短嵌入的原生功能,使得开发者可以在性能和成本之间进行权衡。

Adept Fuyu-Heavy

Adept Fuyu-Heavy是一款新型的多模态模型,专为数字代理设计。它在多模态推理方面表现出色,尤其在UI理解方面表现出色,同时在传统的多模态基准测试中也表现良好。此外,它展示了我们可以扩大Fuyu架构并获得所有相关好处的能力,包括处理任意大小/形状的图像和有效地重复使用现有的变压器优化。它还具有匹配或超越相同计算级别模型性能的能力,尽管需要将部分容量用于图像建模。

Meta-Prompting

Meta-Prompting是一种有效的脚手架技术,旨在增强语言模型(LM)的功能。该方法将单个LM转化为一个多方位的指挥者,擅长管理和整合多个独立的LM查询。通过使用高层指令,元提示引导LM将复杂任务分解为更小、更易管理的子任务。然后,这些子任务由相同LM的不同“专家”实例处理,每个实例都根据特定的定制指令操作。这个过程的核心是LM本身,作为指挥者,它确保这些专家模型的输出之间的无缝沟通和有效整合。它还利用其固有的批判性思维和强大的验证过程来完善和验证最终结果。这种协作提示方法使单个LM能够同时充当全面的指挥者和多样化专家团队,显著提升其在各种任务中的性能。元提示的零射击、任务无关性质极大地简化了用户交互,无需详细的任务特定指令。此外,我们的研究表明,外部工具(如Python解释器)与元提示框架能够无缝集成,从而扩大了其适用性和效用。通过与GPT-4的严格实验,我们证明了元提示优于传统脚手架方法:在所有任务中取平均值,包括24点游戏、一步将军和Python编程难题,使用Python解释器功能的元提示比标准提示高出17.1%,比专家(动态)提示高出17.3%,比多人格提示高出15.2%。

WARM

WARM是一种通过加权平均奖励模型(WARM)来对齐大型语言模型(LLMs)与人类偏好的解决方案。首先,WARM对多个奖励模型进行微调,然后在权重空间中对它们进行平均。通过加权平均,WARM相对于传统的预测集成方法提高了效率,同时改善了在分布转移和偏好不一致性下的可靠性。我们的实验表明,WARM在摘要任务上的表现优于传统方法,使用最佳N和RL方法,WARM提高了LLM预测的整体质量和对齐性。

ReFT

ReFT是一种增强大型语言模型(LLMs)推理能力的简单而有效的方法。它首先通过监督微调(SFT)对模型进行预热,然后使用在线强化学习,具体来说是本文中的PPO算法,进一步微调模型。ReFT通过自动对给定问题进行大量推理路径的采样,并从真实答案中自然地得出奖励,从而显著优于SFT。ReFT的性能可能通过结合推理时策略(如多数投票和重新排名)进一步提升。需要注意的是,ReFT通过学习与SFT相同的训练问题而获得改进,而无需依赖额外或增强的训练问题。这表明ReFT具有更强的泛化能力。

Contrastive Preference Optimization

Contrastive Preference Optimization是一种用于机器翻译的创新方法,通过训练模型避免生成仅仅足够而不完美的翻译,从而显著提高了ALMA模型的性能。该方法在WMT'21、WMT'22和WMT'23测试数据集上可以达到或超过WMT竞赛获胜者和GPT-4的性能。

GLM-4

智谱AI在首届技术开放日上发布了GLM-4和CogView3。GLM-4性能全面提升近60%,支持更长的上下文、更强的多模态支持和更快速的推理。CogView3逼近DALL·E 3的多模态生成能力。产品定位为下一代基座大模型和图像生成AI。

探行AI

探形是行业领先的人工智能(AI)工具平台,提供 AI 对话、AI 绘画、AI 数字人等产品。致力于让机器与人更好的互动,最终目标是让我们把工作交给人工智能而享受更美好的生活。产品定位于为用户提供智能化、高效的工具平台,以满足用户在对话、绘画、数字人等方面的需求。

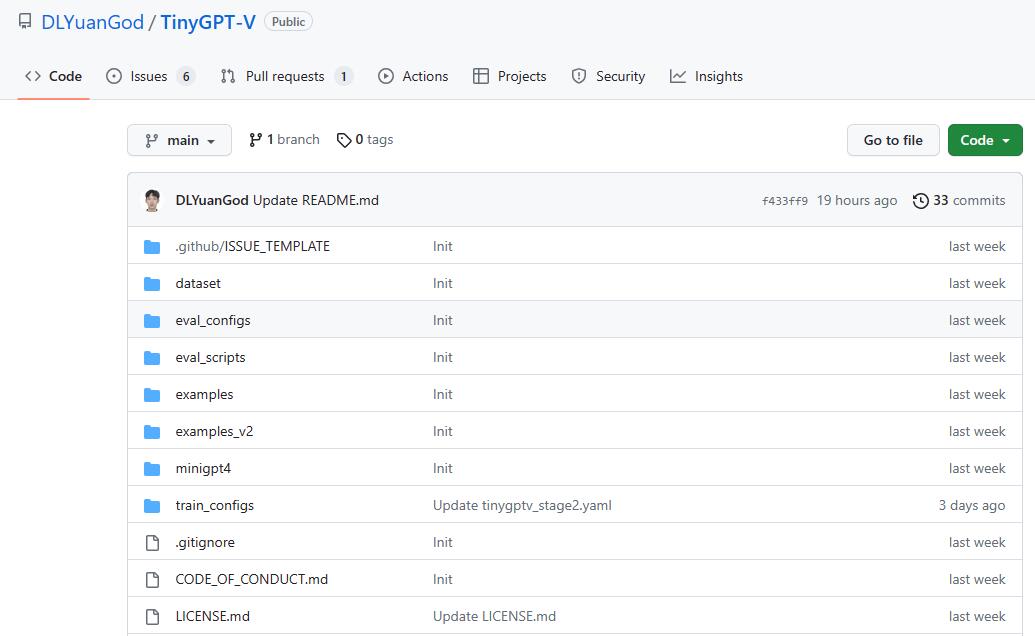

TinyGPT-V

TinyGPT-V 是一种高效的多模态大型语言模型,通过使用小型骨干网络来实现。它具有强大的语言理解和生成能力,适用于各种自然语言处理任务。TinyGPT-V 采用 Phi-2 作为预训练模型,具备出色的性能和效率。

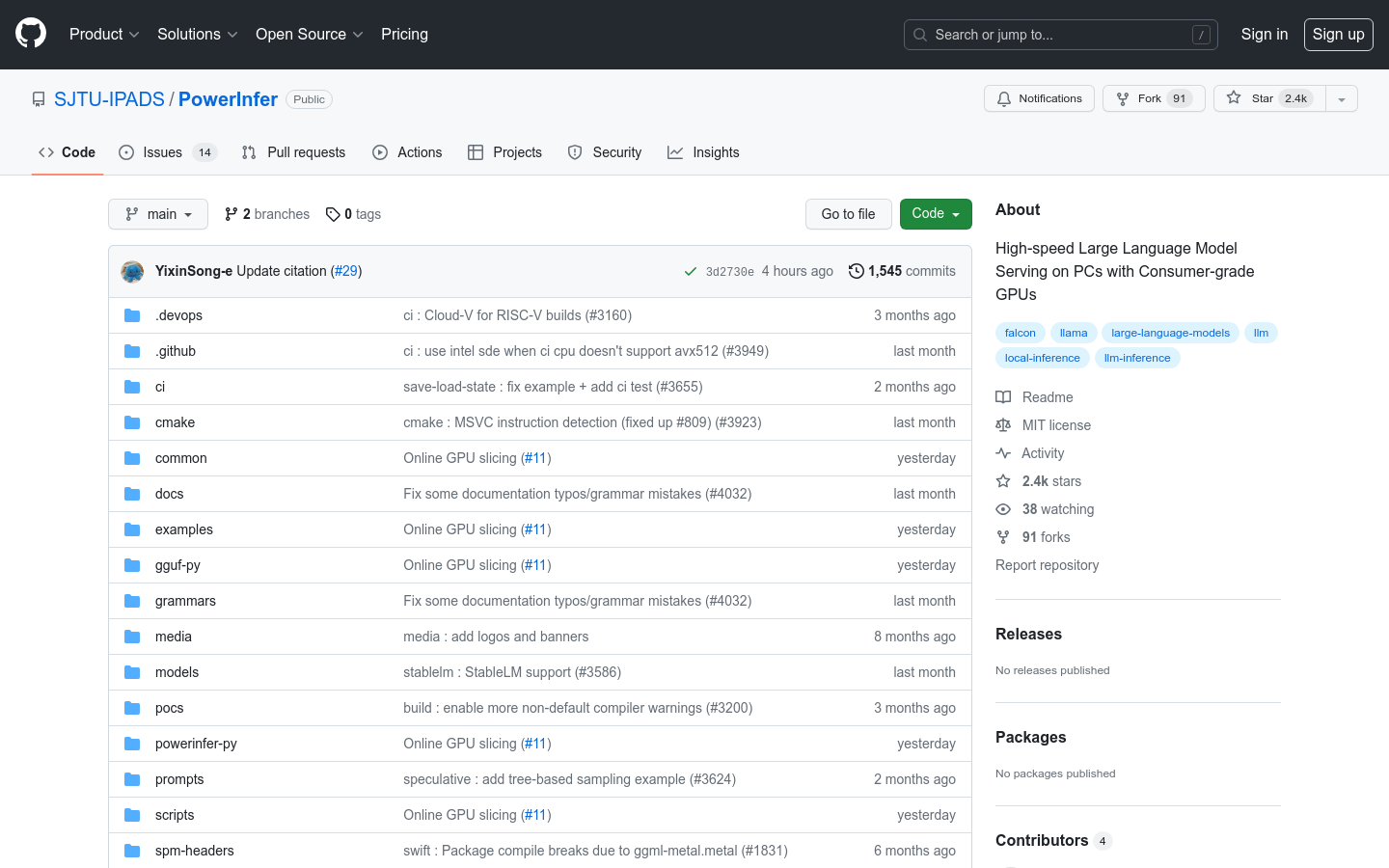

PowerInfer

PowerInfer 是一个在个人电脑上利用消费级 GPU 进行高速大型语言模型推理的引擎。它利用 LLM 推理中的高局部性特点,通过预加载热激活的神经元到 GPU 上,从而显著降低了 GPU 内存需求和 CPU-GPU 数据传输。PowerInfer 还集成了自适应预测器和神经元感知的稀疏运算符,优化神经元激活和计算稀疏性的效率。它可以在单个 NVIDIA RTX 4090 GPU 上以平均每秒 13.20 个标记的生成速率进行推理,比顶级服务器级 A100 GPU 仅低 18%。同时保持模型准确性。